sondern mich auf eines, vielleicht zwei Apps konzentrieren.

Eben zwei kommen mir zurzeit bereits wie etwas zu viel auf einmal vor.

Mit den Wolken hatte ich verschiedene Varianten mit "Haze densitiv" bei der Atmosphäre und "Cloud color" durchgespielt, um den Mond herum verloren die ihre Wirkung, praktisch nur auf der linken Seite sahen diese natürlicher für einen nächtlichen Himmel aus. Dann sollten auf dieser Seite vom Himmel aber ein paar Sterne zum Ausgleich funkeln, um zwei Varianten bei der Retusche verlaufen zu lassen.

Mit der Kugel (Light Surce) habe ich ebenfalls noch etwas gespielt. An die Zahlen, die mich zunächst abschreckten, kann man sich gewöhnen. Hat man erst einmal über den Schieberegler einen akzeptablen Potenzwert (oder wie sich das nannte, e war wohl Exponent) gefunden, lassen die sich wieder einkürzen auf lesbare Zahlen. Im Beispiel auf 2.0 (2.0e+07), wobei für eine Feinabstimmung um 0.5 Schritte genügen sollten, denke ich mir bisher.

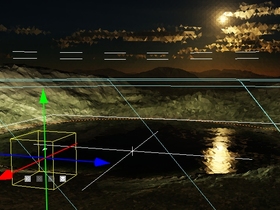

Wichtiger wäre es bei der Kugel zu Anfang gewesen, gleich Visible Objekt zuwählen, denn für mich sah es anfänglich so aus, als würde sich der Grundriss vom Würfel noch über Land befinden, ähnlich wie im ersten Bild. Mit eingeblendeten Objekt war dann zu sehen, dass dieser am Abtauchen ist, wie im zweiten Bild.

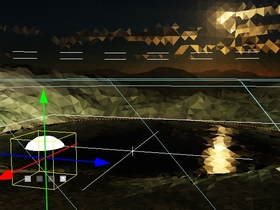

Etwas dichter über der Oberfläche werden Spiegelungen erzeugt, auch mit ausgeblendeten Objekt, doch das Umland erhält wieder etwas mehr nächtliche Schatten, wie im dritten Bild. Luminosity von den Shadern habe ich hierbei wieder auf 0 gesetzt, mir sahen die etwas glitschig aus, doch richtig gefallen mir die Farben noch nicht, werde ich noch weiter anpassen.

Die Kugel habe ich im dritten Bild nicht ausgeblendet, die Spiegelungen auf dem Wasser bleiben auch dann, lassen sich aber leicht retuschieren, denke ich mir. Und ohne Nacharbeit in der Dunkelkammer ging es schon bei der Schwarzweißfotografie nicht ab. Soll ja nur ein Einzelbild werden.

Ob die Kugel sich mit einem Spotlight verträgt, habe ich noch nicht ausprobiert. Zwei Kugeln wollte TG aber scheinbar nicht berechnen, bei einem ersten Test zumindest.

Die Dimensionen sprechen nicht unbedingt dafür, es als Background Image im DAZ Studio zu verwenden, doch wenn der Betrachter keinen weiteren Anhaltspunkt hat, wie eben diese Kugel (Durchmesser bei den Vorschauen 400 Meter, im gerenderten Bild 100 Meter) sollte es im Vordergrund noch möglich sein, ein oder zwei Darsteller einzublenden.

Dazu müsste ich mich dann aber richtig in die Beleuchtung vom DAZ Studio einarbeiten. Dass die Schatten im Background Image sichtbar werden, hatte ich schon einmal probiert, nur noch nicht weiter. Wobei mir erst einmal ein anderes Motiv vorschwebt.

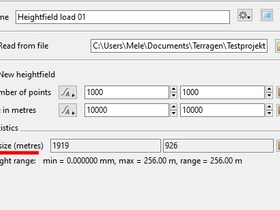

Dazu habe ich heute den Heightmapper ausprobiert. Zuerst die Ortsnamen mit anzeigen lassen, um besser unsere Umgebung zu finden. Angezeigt hat der mir die Höhen mit 24 bis 76 Metern, was hinkommen könnte. Die Größe der exportierten heightmapper.png entspricht des sichtbaren Fläche es Monitors, wobei ich weit reingezoomt habe, und die Bittiefe beträgt 32. Also diese heightmapper.png hat Terragen erst einmal ohne Probleme gefressen.

Kleinere Problemchen danach, hätte ja diese Werte genommen. Es sind nur keine Meter, sondern die Pixel der verwertbaren Fläche vom Browser oder so, in einem mir unbekannten Maßstab. Könnte mir höchsten noch einmal die Ortsnamen anzeigen lassen, um dann grob zu schätzen, wie weit die Entfernung in Pixel ist, oder so ähnlich.

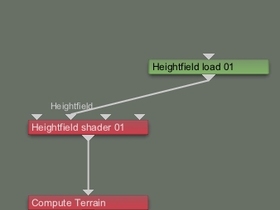

Was mich aber etwas nervt, mein erstes selbstgezeichnetes Heightfield von weiter oben hat TG anders als die neue Datei verknotet. Beides sind nur PNG Dateien, beide habe ich nur über Add Terrain - Heightfield (load file ) geladen. Mein selbstgezeichnetes hat TG aber bei Fractal wrap verknotet und das jetzige nur als Heightfield shader. Ich weiß nicht mehr, was ich beim ersten Versuch anders machte.