So, den Grauwert der Mundmaske habe ich für Neander auf 128 RGB eingestellt, wobei es letztendlich aber nur ein Anhaltswert für lineare Farbprofile wäre. Bei wahrgenommenes Licht (sRGB) oder was auch immer, wäre es nur noch ein Näherungswert. Die größten Unterschiede gab es bei TG zwischen RGB, sRGB, Gamma 2.2, Gamma 1.8 und Gamma 1.0, bei DS weiß ich bisher nicht einmal, mit was unter der Haube gerechnet wird.

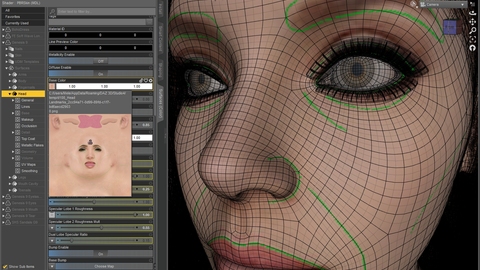

Beim Tattoo habe ich den Rotanteil zugunsten des Blauanteils verringert, auch einmal geschaut, was passiert, wenn ich es unter SSS nur mit 80 % einbinde, weil die SSS Textur ohnehin heller ist, doch es wird noch immer reichlich schwarz dargestellt, statt einem schwarzblauen Farbton, nun ein sehr dunkelgrauer. Doch das würde ich noch hinbekommen, denke ich mir, wenn einmal ein Tattoo benötigt würde.

Anders mit einem Brandzeichen, von Pferden brauche ich keins, für Menschen waren auch einige zu finden, doch der Mensch wird vergesslich, denn erst heute fiel mir ein, ich habe ja selbst kleine am Handgelenk. So etwas kann man mit den Jahren halt vergessen. Das war eine Verbrennung mit Kalk, der eigentlich gelöscht sein sollte, dennoch anfing zu brennen fing. Man erkennt es eigentlich nur daran, dass diese Stellen weniger Farbpigmente enthalten, somit im Sommer etwas heller aussehen.

Habe heute auch viel mit den Malhilfen von DS experimentiert, diese scheinen durchaus hilfreich zu sein und einiges vereinfachen. Doch wem würde es hier interessieren? Bei Blender Themen läuft es, bei DS ist in diesem Bereich eher tote Hose. Aber nein, ganz so ist es nicht, denn die Video Tuts erhalten ja viele Likes und darauf wollte ich mich ja eh mehr konzentrieren.

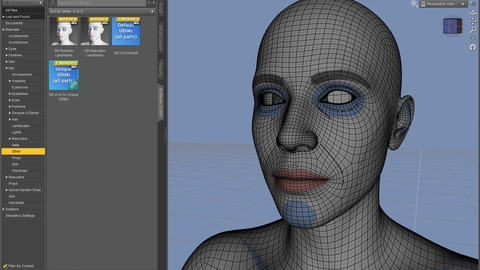

Beginne einmal mit den Landmarks, die nicht nur in Blender oder ZBrush eine Hilfe sein können, sondern z.B. auch in Krita oder GIMP. Als unterste Ebene benutzt, ist es nicht schwieriger, als vergleichsweise ein Malen nach Zahlen. Was aber sicherlich besser wäre, diese nicht für eine beliebige G9 zu verwenden, sondern für einen gewünschten Charakter.

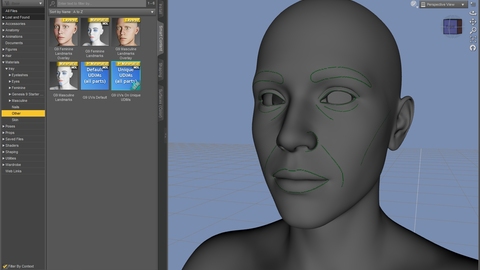

Die Texturen liegen in der Runtime, jedoch es handelt sich nur um eine große, die alle Texturen enthält. Zuschneiden sollte aber kein Problem sein, denn beide Texturen für feminin und maskulin sind 8.192 Pixel groß. Hier z.B. die obere linke Ecke mit 4096 im Quadrat auszuschneiden, ist kein Problem für GIMP oder anderen Bildbearbeitungsprogrammen und der beinahe perfekte Background als Malgrund wäre fertig. Sollte sich ebenfalls beinahe perfekt mit einer UV Map von Blender vereinen lassen, um nach diesen Linien zu schattieren, oder was auch immer.

Schrieb beinahe perfekt, richtig perfekt vermutlich aber nur für Base feminine oder Base maskuline. Bin mir nicht sicher, inwiefern diese sich einem bereits verzogenem Mesh für einen Charakter anpassen würde.

Das habe ich heute nur mit anderen Landsmark getestet, also nicht mit den unter Material, sondern mit einem Layered Overlay. Mit einer Base Figur gut und schön.

Doch wie sieht es mit einem Charakter aus?

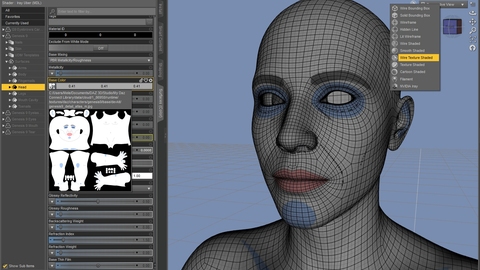

Die Textur mit den Linien, so wie in kleiner Ansicht links zu sehen, liegt in den Temps unter App Data und kann dort kopiert werden. Anschließend mit einem UV Meshansicht von Blender komplettiert oder ohne als Malgrund verwendet werden.

Nun in der Ansicht mit einem Charakter gibt es Abweichungen.

So ist hier z.B. die Unterlippe in der Breite abweichend, ebenso die Augenbrauen.

Der Bereich unter den Augen, den ich noch gerne etwas mehr bei ihr schattieren wollte, dafür hingegen immer noch gut geeignet, denke ich mir. Wenn ich damit aber etwas mehr verändern möchte, sollte ich zukünftig keine graue DEV in Blender für eine UV Ansicht verwenden, sondern den benutzten Charakter. Nach meiner kleinen Übung vor einigen Tagen sollte dies bereits zügiger gehen.